LLM 救星?DeepSeek 推出 DeepSeek-OCR,Token 節省高達 90%

2025.10.21 13:25

Soft4fun.net

[ comments ]

2025 年 10 月 21 日

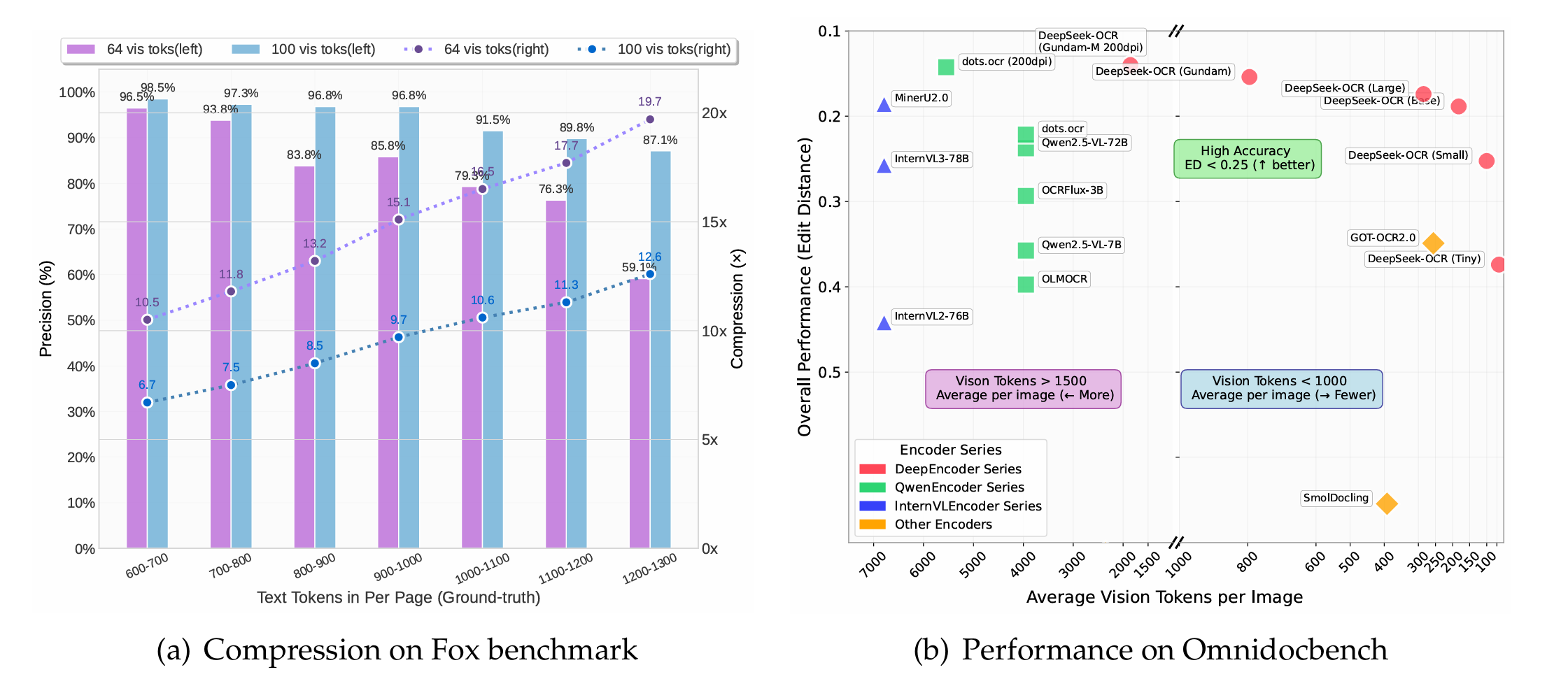

在處理長篇文本時,LLM 往往會因序列過長而消耗大量資源,DeepSeek-AI 最新發表的研究成果 —— DeepSeek-OCR 模型,他以「視覺壓縮」的創新方法,大幅降低 90% 以上的 Token 使用率,為解決 LLM 記憶負擔找出了一條新路。

而 DeepSeek-OCR 的創新點,就在於「把文件轉成圖片 → 圖片轉成極少量的 vision tokens → 再還原成原始文本」,這整個過程就是所謂的 Co…

コメント一覧

まだコメントはありません。