ローカルAI実行ツールのOllamaがMLXに対応してMacでの動作が高速に

2026.04.02 13:50

Livedoor.com

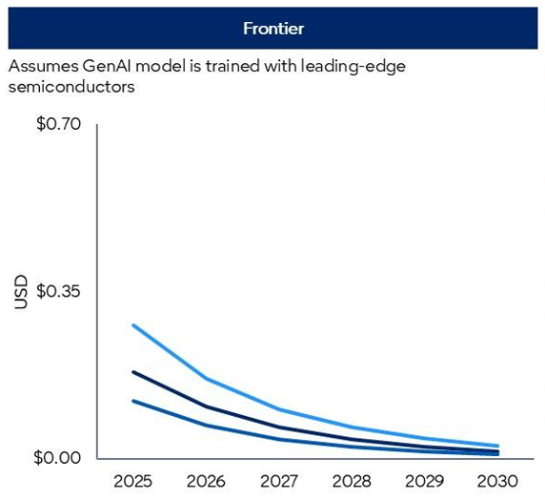

数多くのAIモデルをローカル環境で実行できるツール「Ollama」が、Appleの機械学習フレームワークであるMLXを基盤としてAppleシリコンに最適化したプレビュー版である「Ollama 0.19」を公開しました。このアップデートにより、macOS上での動作性能が大幅に向上し、パーソナルアシスタントやコーディングエージェントといった高度なタスクをこれまで以上に高速に実行できるようになります。Ollama is now powered by MLX on Apple Silicon in preview · O…

検索

人気記事

コメント一覧

まだコメントはありません。